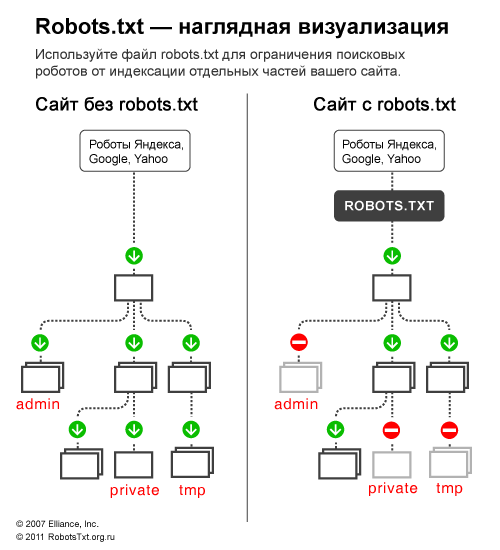

Все поисковые роботы при заходе на сайт в первую очередь ищут файл robots.txt.

Файл robots.txt – это текстовый файл, находящийся в корневой директории сайта, в котором записываются специальные инструкции для поисковых роботов. Эти инструкции могут запрещать к индексации некоторые разделы или страницы на сайте, указывать на правильное «зеркалирование» домена, рекомендовать поисковому роботу соблюдать определенный временной интервал между скачиванием документов с сервера и т.д.

Создание robots.txt

Чтобы создать файл robots.txt, нужен простой текстовый файл. Если вы не собираетесь создавать запреты к индексации, можно сделать пустой файл robots.txt.

Для Рунета самой часто встречающейся задачей является создание файла robots.txt для Яндекса, так как сейчас Яндекс – самая популярная поисковая система. Важно уметь правильно использовать директиву Host, которую соблюдает этот поисковик, а сам файл robot.txt можно представить так.

информация взята с сайта Сайт «все о файле robots.txt»